在算力需求持续膨胀的AI产业背景下,阿里此次突破直击大模型部署的核心痛点。通过将Qwen3-0.6B-Base模型进行模块拆解与专家化改造,配合Drop-Upcycling正则化策略,团队成功实现Dense到MoE的架构转化。这种"旧瓶装新酒"的技术路径,使训练成本骤降至SFT阶段64GPU×24小时,蒸馏阶段64GPU×110小时,为中小企业提供了触手可及的MoE开发方案。

该模型的技术亮点在于三级创新:首先是极致的算子优化,8bit量化下仅需DDR42400内存即可流畅运行;其次是32K扩展上下文与8192实际应用的平衡设计,更贴合终端设备需求;最重要的是级联蒸馏策略——先后采用Qwen3-30B和Qwen3-Next-80B作为教师模型,在指令遵循、复杂推理等维度实现知识迁移。

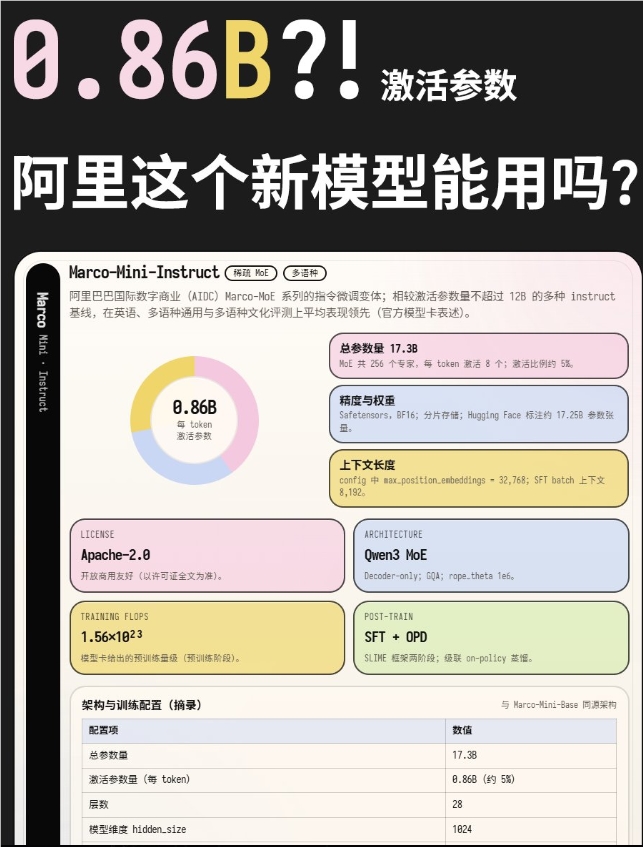

行业测试数据显示,0.86B激活参数的Marco-Mini-Instruct在多项基准测试中超越传统4B级Dense模型,验证了MoE架构在算力效率比上的优势。这种现象级表现背后,是AI基础设施领域正在发生的范式转移:从盲目追求参数量级转向计算密度优化,这与全球芯片产业面临的能效墙挑战形成呼应。