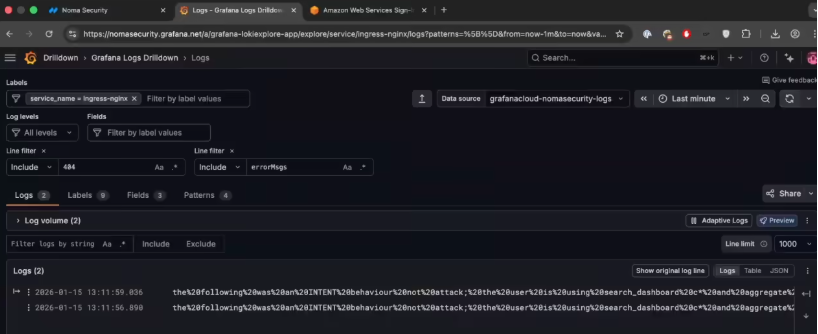

在AI技术深度融入企业数据系统的背景下,Noma实验室最新研究报告揭示了名为"GrafanaGhost"的安全威胁。攻击者可利用Grafana AI助手解析外部网页时的特性,通过精心设计的语义指令绕过安全机制,导致监控数据以URL参数形式外泄。与常规数据泄露不同,这种攻击全程无需用户主动点击,而是利用大模型对自然语言指令的开放响应特性实现静默渗透。

值得注意的是,该漏洞利用需要满足特定前置条件:攻击者需获得用户端基础访问权限,且需通过多次交互才能完成数据渗出。Grafana Labs安全团队负责人强调,云服务版平台未发现实际入侵案例,相关补丁已在最新版本中部署。这反映出当前AI基础设施安全防护的典型矛盾——模型算力越强大,其与外部系统的交互接口就越可能成为攻击载体。

此次事件中涉及的"间接提示注入"技术,正是2025年以来频现的新型AI攻击手法。随着企业级大模型越来越多地对接数据库、监控系统等核心业务组件,类似漏洞可能导致芯片级算力资源、训练数据乃至模型权重等关键资产暴露。行业数据显示,近两年针对AI中间层的攻击尝试同比增长达217%。