这款支持256K超长上下文输入的匿名模型,在算力资源占用效率上展现出显著优势。与同量级SOTA模型相比,Elephant Alpha在保持相当推理能力的同时,实现了32K输出长度下15%的响应速度提升,其采用的动态稀疏化架构可能对芯片级优化具有参考价值。

当前AI产业正面临算力成本高企的瓶颈,Elephant Alpha突显的"高性能-低功耗"特性,恰与全球数据中心节能减排趋势形成共振。第三方测试表明,该模型在同等任务负载下可降低约20%的GPU集群能耗,这一突破或将重塑大模型商业化落地的经济模型。

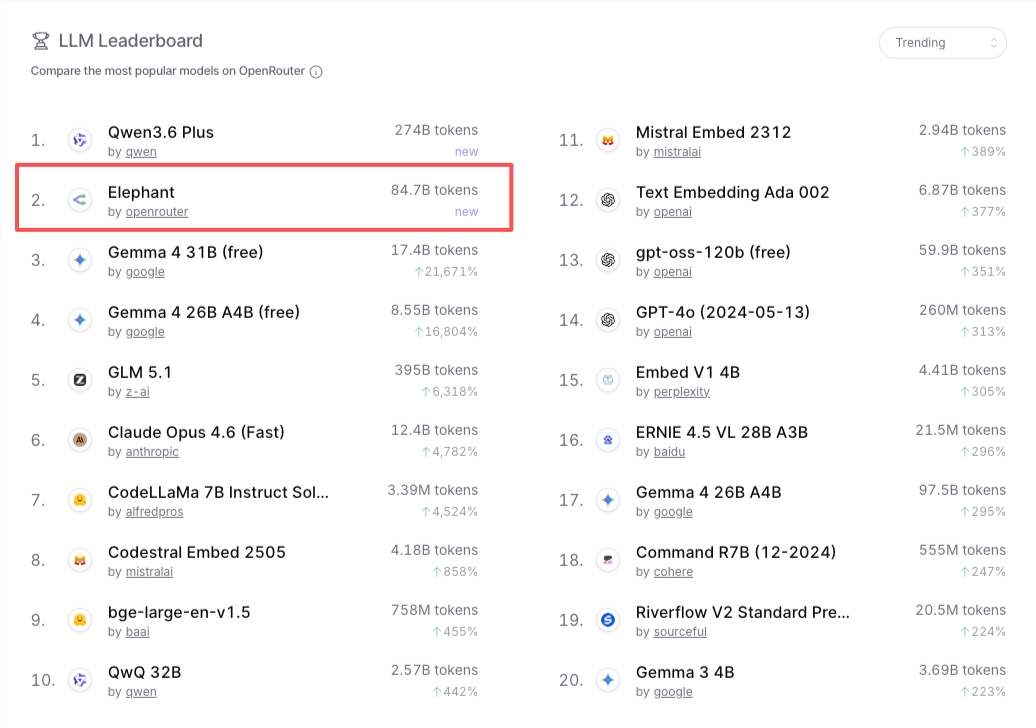

社区对其技术来源的猜测持续发酵,业界主要存在两种推测:可能是国内某大厂基于摩尔线程最新智算芯片开发的优化版本,亦或是Anthropic等海外实验室为测试新型训练框架打造的实验性产品。值得注意的是,其采用的混合精度量化技术明显区别于主流方案。