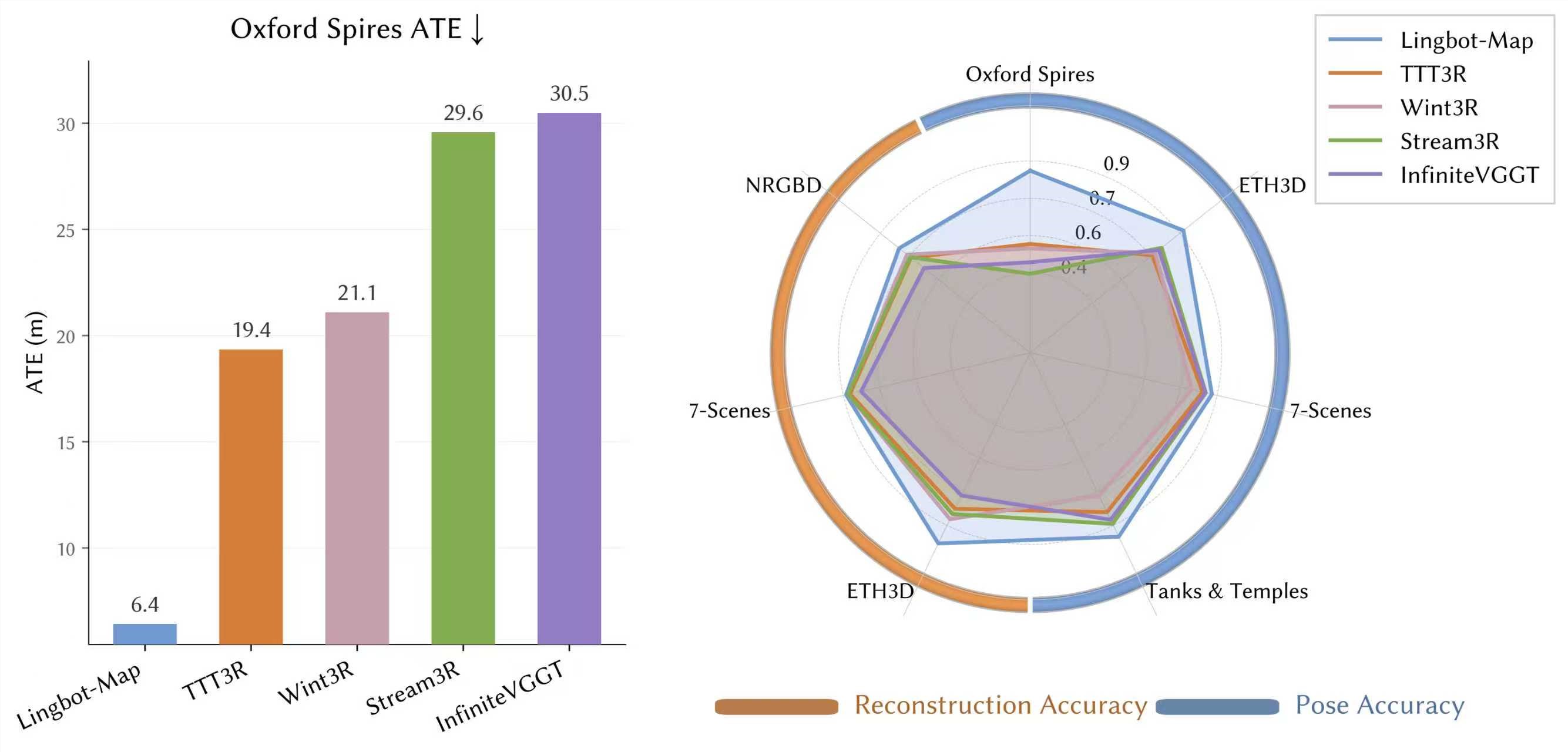

在当前AI产业加速向具身智能演进的过程中,实时空间理解能力成为制约行业发展的关键瓶颈。蚂蚁灵波此次发布的LingBot-Map模型采用创新流式架构,打破传统三维重建需完整视频输入的限制,实现"边采集边建模"的突破性技术路径。测试数据显示,其在国际权威Oxford Spires数据集上的轨迹误差较现有流式方法降低66%,甚至超越部分依赖离线算力的算法。

该模型的核心价值在于重构了AI感知的算力分配逻辑。通过动态优化神经网络计算单元与内存占用的平衡,LingBot-Map在消费级GPU上即可实现超万帧长视频的稳定运行,精度衰减控制在0.3%以内。这一特性使其特别适合自动驾驶、服务机器人等需要长期在线学习的场景,有效缓解了终端设备的芯片算力压力。

值得注意的是,这是蚂蚁灵波继世界模型、VLA动作模型后,在AI基座技术栈中的又一战略布局。技术团队通过融合时空注意力机制与轻量化卷积模块,使模型在保持大模型表征能力的同时,将参数量压缩至可部署水平。开源社区可通过Hugging Face和ModelScope平台获取完整代码及预训练权重。

从产业视角看,LingBot-Map的推出标志着空间计算正从专用硬件向通用AI框架迁移。其单摄像头解决方案显著降低了AR/VR设备的空间感知成本,而实时建图能力则为仓储物流、智能巡检等工业场景提供了新的数字化改造路径。