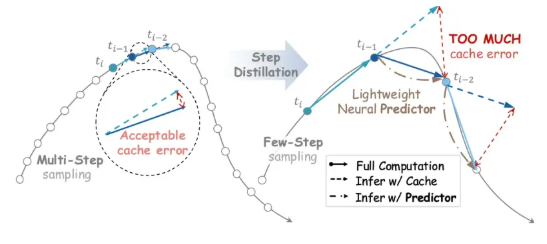

随着多模态大模型对算力基础设施的需求激增,视频生成技术的效率始终是制约产业落地的关键瓶颈。传统特征缓存方案在少步蒸馏模型上会产生高达23%的缓存误差,而DisCa的创新之处在于引入轻量级神经网络预测器,通过对抗学习动态修正特征演化轨迹,这标志着学界首次在蒸馏后少步模型上实现可学习的缓存加速。

在训练策略方面,团队对MIT何恺明团队提出的MeanFlow方案做出重要调整。研究发现,直接套用图像生成领域的"一步生成"目标会导致视频模型训练稳定性下降。通过约束步长范围的工程化改进,R-MeanFlow策略与谷歌等机构的最新研究形成技术共振,这种务实的修正路径正成为AI工程领域的新共识。

值得关注的是,该方案同时开源了完整代码和模型权重,这种"论文+工程包"的完整输出模式,显著降低了企业部署视频生成能力的门槛。据测算,采用DisCa技术的系统可在同等芯片配置下支持更高并发生成任务,这对直播、电商等实时视频需求场景具有直接商业价值。