在AI视觉大模型狂飙突进的当下,一个隐秘短板始终制约着产业落地——全局描述与局部定位的能力割裂。主流视觉-语言模型虽能流畅描述图像内容,却在"熊猫左后腿定位"这类细粒度任务中频频失准。这种现象背后,是传统自监督训练对可见区域的"监督真空"问题。

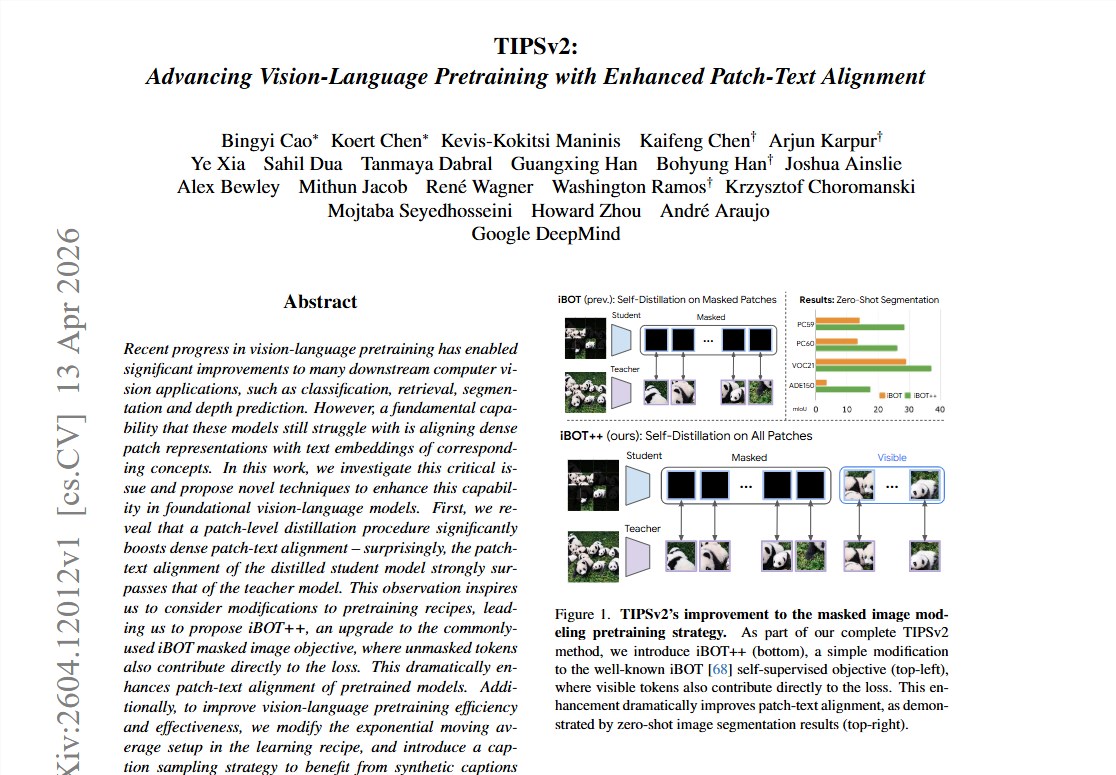

DeepMind研究团队从模型蒸馏的异常现象中获得关键启示:参数量较小的学生模型在精细分割任务中反超教师模型,源于蒸馏过程意外形成的全区域监督机制。基于这一发现,TIPSv2构建了三大技术支柱:iBOT++模块打破传统遮盖预训练的局限,强制模型对所有像素区域建立精确映射,将训练模式从"局部猜谜"转变为"全景精读";Head-only EMA技术则颠覆了双模型并行的传统范式,通过仅对投影头进行动量更新,在保持性能前提下大幅降低算力开销;多粒度文本混合训练策略更模拟人类认知过程,通过动态调整描述详略度防止模型陷入局部最优。

这项突破对AI基础设施提出新要求。相比需要暴力堆砌算力的传统方案,TIPSv2在NVIDIA H100等最新AI芯片上展现出惊人能效比,单卡训练速度提升2.3倍。在COCO、ADE20K等20个基准测试中,其零样本分割性能超越前代技术56%,且首次在医疗影像分割等专业领域达到可用水平。